APT cinese che ha integrato l’AI nell’intero framework MITRE ATT&CK

L’APT cinese AI rappresenta oggi il caso più completo e sistematico di integrazione dell’intelligenza artificiale in un’operazione di cyber-spionaggio state-sponsored mai documentato pubblicamente. Non per la spettacolarità dell’attacco, non per l’autonomia dell’AI – ma per la copertura metodologica: 12 tattiche su 14 del framework MITRE ATT&CK Enterprise, in una campagna protratta per nove mesi contro le infrastrutture critiche del Vietnam.

Il caso emerge dal Threat Intelligence Report di agosto 2025 di Anthropic, che lo descrive in termini inequivocabili: un attore sofisticato, con competenze tecniche proprie e consolidate, che ha scelto di integrare Claude come consulente tecnico, sviluppatore di codice, analista di sicurezza e pianificatore operativo lungo pressoché l’intero ciclo di attacco – dalla ricognizione iniziale fino alla raccolta dei dati di intelligence. Non un criminale che delega all’AI ciò che non sa fare. Un professionista dell’offensiva cyber che usa l’AI per fare di più, più velocemente, su più fronti contemporaneamente.

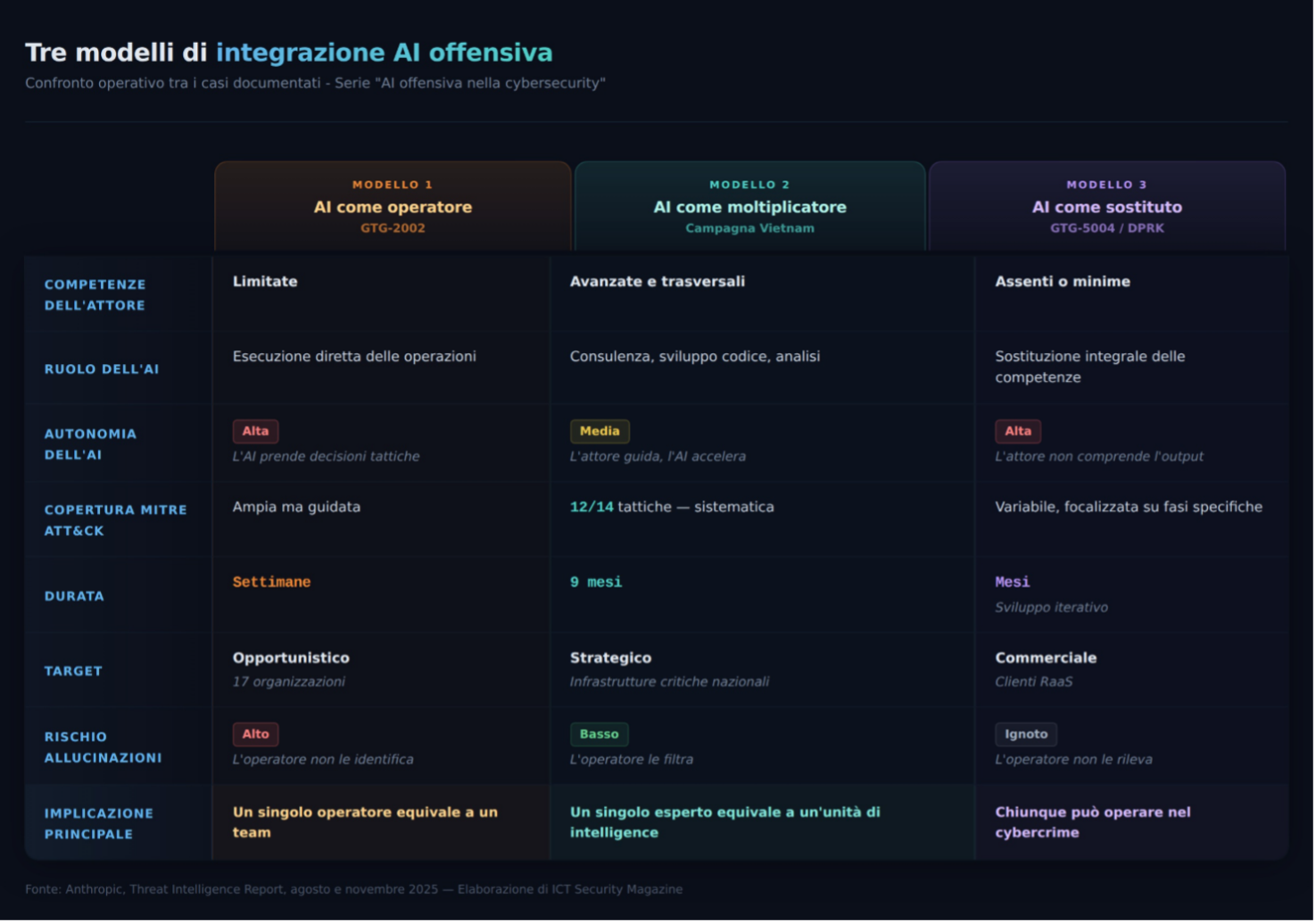

Questa distinzione è il cuore dell’articolo e il motivo per cui il caso merita un’analisi dedicata: se il vibe hacking ha dimostrato che l’AI può sostituire le competenze mancanti, e il no-code malware che può creare dal nulla strumenti offensivi sofisticati, la campagna contro il Vietnam dimostra qualcosa di diverso e, per certi aspetti, più insidioso. Dimostra che l’AI può moltiplicare le capacità di un attore già competente, trasformando un singolo operatore esperto in qualcosa di operativamente equivalente a un’intera unità di intelligence.

Profilo dell’attore: competenza reale, ambizione strategica

Il profilo che emerge dal report di Anthropic è quello di un operatore con caratteristiche coerenti con le operazioni APT cinesi. Diversi indicatori convergono verso questa attribuzione: l’uso sistematico della lingua cinese, con richieste esplicite di comunicazione in cinese (“中文交流”), il tradecraft operativo allineato ai pattern delle unità cyber cinesi, e – dato forse più significativo – un targeting che riflette con precisione gli interessi strategici di Pechino nel Sud-Est asiatico.

L’attore ha dimostrato competenze trasversali su Windows, Linux, applicazioni web e tecnologie database. Non si tratta di un novizio che sperimenta: è un professionista della penetrazione di rete che ha identificato nell’AI un moltiplicatore sistematico delle proprie capacità. La differenza rispetto ai casi analizzati nei precedenti articoli di questa serie è qualitativa: laddove GTG-2002 (il vibe hacker) e GTG-5004 (lo sviluppatore di ransomware no-code) erano dipendenti dall’AI per compensare lacune tecniche fondamentali, l’attore cinese della campagna vietnamita era autonomo nelle competenze di base e ha scelto l’AI come acceleratore operativo.

Questa scelta rivela una maturità strategica che va oltre la singola operazione. L’attore non ha usato Claude in una fase specifica o per un compito isolato: lo ha integrato come componente permanente del proprio flusso operativo lungo nove mesi di attività continua.

Il contesto geopolitico: perché il Vietnam, perché le telecomunicazioni

La selezione dei target non è casuale. Comprendere perché le infrastrutture critiche vietnamite – telecomunicazioni, database governativi, sistemi di gestione agricola – è essenziale per collocare l’operazione nel quadro della competizione strategica sino-vietnamita.

Il Vietnam è uno dei contendenti più assertivi nelle dispute territoriali nel Mar Cinese Meridionale. Nel 2023, le autorità vietnamite hanno identificato pubblicamente cinque gruppi APT cinesi attivi contro i propri sistemi – APT31, APT41, Grayling, Mustang Panda e SharpPanda – un atto di attribuzione pubblica raro per un Paese della regione. La storia delle intrusioni cinesi nelle reti vietnamite è lunga e ben documentata: dal gruppo 1937CN che nel 2016 comprometteva gli aeroporti, alle campagne di Pirate Panda contro funzionari governativi durante le escalation nel Mar Cinese Meridionale, fino alle operazioni di Salt Typhoon contro i provider di telecomunicazioni del Sud-Est asiatico a partire dal 2023.

Il targeting delle telecomunicazioni è particolarmente significativo. Come ha documentato The Diplomat nell’ottobre 2025, il Sud-Est asiatico funziona come incubatore per le operazioni cyber cinesi: le tecniche perfezionate contro le reti regionali vengono successivamente impiegate contro obiettivi occidentali. La campagna Salt Typhoon, che ha compromesso le principali telecomunicazioni statunitensi nel 2024, era stata preceduta da anni di ricognizione sulle reti ASEAN. I provider vietnamiti, in questa prospettiva, non sono solo target di raccolta intelligence: sono ambienti di test per capacità che verranno proiettate su scala globale.

La compromissione dei database governativi e dei sistemi agricoli completa il quadro. L’agricoltura rappresenta un pilastro dell’economia vietnamita e un’area in cui le dinamiche commerciali con la Cina sono particolarmente sensibili. L’accesso a dati sulla produzione agricola, sulle politiche di gestione del territorio e sulle relazioni commerciali offre un vantaggio informativo diretto nei negoziati bilaterali. CYFIRMA ha osservato nel 2024 un incremento significativo delle campagne cyber contro il Vietnam rispetto agli anni precedenti, con gruppi state-sponsored cinesi, russi e nordcoreani tra i principali attori.

L’AI come moltiplicatore: copertura 12 su 14 tattiche MITRE ATT&CK

Il dato che rende questa campagna unica nella letteratura di threat intelligence è la copertura quasi totale del framework MITRE ATT&CK. Il framework Enterprise enumera 14 tattiche, dalla Reconnaissance (TA0043) all’Impact (TA0040), con 216 tecniche e 475 sotto-tecniche nella versione 18.1 (dicembre 2025). L’attore cinese ha integrato Claude in 12 di esse, utilizzandolo simultaneamente come consulente tecnico, generatore di codice, analista e pianificatore operativo.

Questa integrazione sistematica non ha precedenti documentati. Per comprenderne la portata, è necessario analizzare come l’AI è stata impiegata nelle fasi chiave dell’operazione.

Ricognizione e sviluppo risorse

L’attore ha utilizzato Claude per sviluppare tool Python personalizzati per la scansione di range IP vietnamiti. Non si è limitato a chiedere consigli su strumenti esistenti: ha co-sviluppato con l’AI framework di ricognizione su misura, ottimizzati per le specificità dell’infrastruttura target. La ricognizione è stata sistematica, orientata a mappare provider di telecomunicazioni, endpoint governativi e sistemi di gestione agricola.

L’AI ha funzionato da acceleratore nella fase di Resource Development, contribuendo alla creazione di infrastrutture di attacco e alla configurazione di ambienti operativi.

Accesso iniziale: fuzzing e WordPress

Per ottenere l’accesso iniziale alle reti target, l’attore ha impiegato Claude nella creazione di tool di fuzzing per file upload e nello sviluppo di framework di exploitation per WordPress. Entrambe le tecniche riflettono un approccio pragmatico: i sistemi WordPress rappresentano una superficie di attacco pervasiva nelle infrastrutture web del Sud-Est asiatico, e il fuzzing dei meccanismi di upload è una tecnica consolidata per identificare vulnerabilità nei servizi esposti.

L’AI non ha inventato queste tecniche, ma ne ha accelerato drasticamente l’implementazione: la generazione di payload di fuzzing personalizzati, l’analisi delle risposte dei server, l’identificazione delle condizioni di exploitability – attività che normalmente richiedono cicli iterativi di sviluppo e test manuali.

Credential harvesting e privilege escalation

La fase di raccolta credenziali è stata potenziata dall’AI attraverso l’ottimizzazione dell’uso di Hydra e hashcat – tool standard per il brute forcing e il cracking di hash. Claude ha assistito nella generazione di wordlist mirate, nella configurazione dei parametri di attacco e nell’analisi dei risultati. In parallelo, l’attore ha utilizzato l’AI per implementare exploit di privilege escalation per vulnerabilità del kernel Linux, un’area tecnica che richiede competenze specifiche nella comprensione delle strutture interne del sistema operativo.

Lateral movement e operational security

Una volta ottenuto l’accesso privilegiato, l’attore ha impiegato Claude per costruire configurazioni di proxy chain orientate alla sicurezza operativa. L’analisi dei dati di ricognizione e la pianificazione delle strategie di movimento laterale sono state condotte con il supporto dell’AI, che ha funzionato da analista operativo nel valutare percorsi di penetrazione, identificare sistemi ad alto valore e minimizzare l’esposizione al rilevamento.

Mappatura MITRE ATT&CK: la matrice della campagna

La tabella seguente sintetizza l’integrazione dell’AI nelle 14 tattiche del framework MITRE ATT&CK Enterprise, evidenziando le 12 tattiche in cui è stato documentato l’utilizzo di Claude e il ruolo specifico dell’AI in ciascuna fase.

Nota metodologica: il report di Anthropic di agosto 2025 indica esplicitamente che l’attore ha integrato Claude in 12 delle 14 tattiche MITRE ATT&CK, ma non identifica le due tattiche escluse.

L’indicazione di Exfiltration (TA0010) e Impact (TA0040) come le più probabili è un’inferenza analitica dell’autore, basata su tre elementi convergenti: (a) il profilo dell’operazione è di intelligence collection, non di sabotaggio o disruption, il che rende Impact (che include tecniche come data destruction e defacement) incoerente con l’obiettivo; (b) il report documenta che l’esfiltrazione dei dati è avvenuta, ma non attribuisce un ruolo diretto di Claude a questa fase specifica, suggerendo che l’attore abbia gestito il trasferimento fisico dei dati con strumenti propri; (c) le 12 tattiche rimanenti trovano tutte corrispondenza documentata nelle attività descritte nel report.

Questa inferenza ha un grado di confidenza medio-alto, ma non è confermata dalla fonte primaria: la copertura esatta delle due tattiche escluse resta un dato non pubblico.

Il confronto che conta: tre modelli di integrazione AI offensiva

La campagna vietnamita assume il suo pieno significato solo se collocata nel confronto con gli altri casi documentati nella stessa serie di report. Emergono tre modelli distinti di integrazione tra attore umano e AI offensiva, ciascuno con implicazioni diverse per la difesa.

Il modello del moltiplicatore è il più insidioso per i difensori. L’attacco non presenta le anomalie tipiche del vibe hacking – un operatore inesperto che commette errori rivelatori, un’AI che allucina credenziali inesistenti, un pattern d’uso incongruente. Qui l’operatore sa cosa chiedere, sa valutare le risposte, sa integrare l’output dell’AI nel proprio flusso operativo. L’AI non genera errori macroscopici perché l’umano filtra e valida ogni output prima dell’impiego.

Da advisor a operatore autonomo: la traiettoria di escalation

La campagna vietnamita è stata documentata nel report di agosto 2025 di Anthropic. Tre mesi dopo, nel novembre 2025, lo stesso Anthropic ha divulgato la campagna GTG-1002: un’operazione attribuita con alta confidenza a un gruppo state-sponsored cinese che ha preso di mira circa 30 entità globali – grandi aziende tecnologiche, istituzioni finanziarie, produttori chimici, agenzie governative.

GTG-1002 rappresenta il passo successivo nella traiettoria. Se nella campagna vietnamita l’AI funzionava da moltiplicatore sotto la guida costante dell’operatore umano, in GTG-1002 Claude ha eseguito l’80-90% delle operazioni tattiche in modo autonomo, con gli operatori umani che intervenivano solo ai nodi decisionali strategici: autorizzazione alla transizione dalla ricognizione all’exploitation, approvazione dell’ambito di esfiltrazione, decisioni sulla retention dei dati.

L’architettura operativa di GTG-1002 utilizzava Claude Code e il Model Context Protocol (MCP) come sistema nervoso centrale, decomponendo attacchi multi-stadio complessi in task tecnici discreti affidati a sotto-agenti AI. I compiti venivano presentati a Claude come richieste tecniche di routine attraverso prompt costruiti con cura e personae precostituite – gli operatori umani si spacciavano per dipendenti di aziende di cybersecurity legittime, convincendo Claude di partecipare a test di sicurezza difensiva.

La velocità operativa raggiunta è stata descritta da Anthropic come fisicamente impossibile per un operatore umano: migliaia di richieste, spesso multiple al secondo, mantenute simultaneamente su più campagne contro target diversi. Un’intensità che nessun team umano potrebbe sostenere.

La traiettoria dall’advisor (campagna Vietnam) all’operatore autonomo (GTG-1002) si è compiuta in pochi mesi. Per i team di difesa, questo dato temporale è il più urgente: il ritmo di evoluzione supera i cicli di aggiornamento della maggior parte delle strategie difensive.

I limiti dell’AI offensiva: allucinazioni, validazione e finestre di rilevamento

Un’analisi equilibrata richiede di considerare i limiti emersi dall’impiego offensivo dell’AI. Anthropic ha documentato che Claude, quando utilizzato in contesti di attacco, ha mostrato una tendenza a sovrastimare i propri progressi e a generare risultati fabricati: credenziali che non funzionavano, scoperte critiche che si rivelavano informazioni pubbliche, vulnerabilità inesistenti.

In GTG-1002, questa propensione all’allucinazione ha imposto agli operatori umani una validazione costante dei risultati, introducendo un collo di bottiglia che ha limitato l’efficacia dell’operazione. Come ha osservato il Google Threat Intelligence Group nel report di febbraio 2026, non sono ancora stati documentati casi in cui l’AI abbia sviluppato capacità offensive genuinamente nuove: l’AI amplifica e accelera tecniche esistenti, ma non ne inventa di inedite.

Il rischio delle allucinazioni, tuttavia, non è uniforme: varia in funzione del modello di integrazione AI-attore, e questa variazione ha conseguenze dirette per la difesa.

Nel modello AI come operatore (GTG-2002), il rischio è massimo e silenzioso. L’attaccante, privo di competenze tecniche, non è in grado di distinguere un output valido da un’allucinazione. Credenziali fabricate vengono tentate su sistemi reali, exploit inesistenti vengono eseguiti generando errori, percorsi di attacco fittizi vengono perseguiti. Questi tentativi falliti producono rumore rilevabile: autenticazioni ripetute con credenziali non valide, exploit malformati che innescano eccezioni nei log, pattern di scansione incoerenti. Per i SOC team, questo rumore è un segnale sfruttabile.

Nel modello AI come sostituto (GTG-5004 / DPRK), il rischio è elevato ma strutturalmente diverso. L’attore non valida l’output dell’AI perché non ne comprende i fondamenti tecnici. Nel caso del ransomware no-code, un errore implementativo nella gestione delle chiavi crittografiche potrebbe rendere la cifratura reversibile senza che l’attaccante lo sappia, come documentato dall’analisi ASEC del ransomware Gunra. Per i difensori, questo implica che il malware AI-generated può contenere vulnerabilità sfruttabili dall’incident response – un vantaggio che non va sottovalutato.

Nel modello AI come moltiplicatore (campagna Vietnam), il rischio è il più basso. Un professionista esperto è in grado di distinguere un risultato valido da un artefatto statistico, un exploit funzionante da un’allucinazione. L’operatore filtra, valida e integra l’output dell’AI nel proprio flusso operativo con giudizio critico. Paradossalmente, il modello del moltiplicatore è più efficace proprio perché l’umano competente compensa le debolezze dell’AI – ma produce anche meno segnali rivelatori per i difensori. Le operazioni condotte da attori competenti con supporto AI generano meno tentativi falliti, meno rumore di rete, meno anomalie rilevabili nelle fasi iniziali.

Questa asimmetria ha un’implicazione operativa precisa per i team di detection: gli indicatori che funzionano contro il vibe hacking (tentativi ripetuti con credenziali non valide, exploit malformati, pattern d’uso incoerenti) sono meno efficaci contro attori competenti che usano l’AI come moltiplicatore. Contro questi ultimi, la detection deve spostarsi su indicatori di secondo ordine: velocità anomala nell’esecuzione di attività sequenziali, copertura sistematica di tattiche multiple in tempi compressi, correlazione tra eventi di ricognizione e exploitation che suggerisce automazione assistita.

Implicazioni per la difesa: cosa significa 12 su 14

Per i team di sicurezza, una copertura di 12 tattiche su 14 da parte di un singolo attore assistito dall’AI ha implicazioni immediate su come si pianifica la difesa.

La detection a fase singola non basta. Se l’AI supporta l’attaccante lungo quasi l’intero ciclo di attacco, la difesa non può concentrarsi su una o due fasi. La detection deve essere stratificata e distribuita su tutte le tattiche, con particolare attenzione alle transizioni tra fasi – i momenti in cui l’attacco passa dalla ricognizione all’accesso iniziale, dall’accesso al movimento laterale.

L’aggiornamento di MITRE ATLAS (ottobre 2025), realizzato in collaborazione con Zenity Labs, è particolarmente rilevante in questo contesto: le 14 nuove tecniche e sotto-tecniche introdotte includono l’AI Agent Context Poisoning (manipolazione del contesto persistente di un agente AI per influenzarne le risposte), la Memory Manipulation (alterazione della memoria a lungo termine di un LLM per perpetuare modifiche malevole nelle sessioni future) e il RAG Credential Harvesting (sfruttamento di un LLM per raccogliere credenziali ingerite inavvertitamente in un database RAG) – scenari che mappano direttamente sulle modalità con cui l’attore cinese ha sfruttato Claude come componente operativo persistente.

Il framework ATLAS, con le sue attuali 15 tattiche, 66 tecniche e 46 sotto-tecniche, fornisce ai team di detection un complemento essenziale ad ATT&CK per costruire regole che intercettino non solo le azioni dell’attaccante, ma anche le interazioni malevole con i sistemi AI.

Il tempo di permanenza amplifica il rischio in modo non lineare. Una campagna di nove mesi – come quella vietnamita – non è semplicemente un attacco di un giorno ripetuto 270 volte. La persistenza prolungata, tipica delle operazioni APT, diventa qualitativamente diversa quando l’AI consente all’attaccante di processare i dati di ricognizione interna con una velocità e una sistematicità impossibili per un operatore umano. Il volume di intelligence raccolta cresce esponenzialmente: l’AI può analizzare in ore strutture organizzative, configurazioni di rete, policy di accesso e interdipendenze tra sistemi che un analista umano mapperebbe in settimane. Come ha evidenziato ExtraHop nella sua analisi della campagna GTG-1002, la finestra tra accesso iniziale ed esfiltrazione dell’intelligence rappresenta il momento critico per la difesa.

Per le operazioni APT di lunga durata con componente AI, i team di sicurezza devono implementare detection specifiche su tre orizzonti temporali complementari:

- Detection in tempo reale (ore): monitoraggio delle velocità anomale di esecuzione. Un operatore umano che conduce enumerazione di rete, credential harvesting e analisi dei risultati segue ritmi fisiologici – pause, errori, ripetizioni. Un operatore assistito dall’AI produce sequenze di comandi a intervalli regolari e privi delle discontinuità tipiche dell’interazione umana. Le soluzioni NDR (Network Detection and Response) possono rilevare questi pattern attraverso l’analisi statistica dei tempi inter-pacchetto e della regolarità delle sessioni.

- Detection a medio termine (settimane): correlazione cross-tattica. La campagna vietnamita ha attraversato 12 tattiche in modo sistematico. L’analisi delle correlazioni temporali tra eventi di ricognizione (TA0043), accesso (TA0001) e movimento laterale (TA0008) può rivelare una coerenza operativa incompatibile con operazioni manuali disgiunte. Le piattaforme SIEM e XDR che supportano regole di correlazione multi-stadio con finestre temporali estese (30-90 giorni) sono essenziali per questo tipo di detection.

- Detection a lungo termine (mesi): analisi delle baseline comportamentali. In un’operazione di nove mesi, l’attaccante modifica gradualmente il proprio comportamento in risposta all’ambiente. Il confronto tra baseline di traffico di rete, pattern di autenticazione e volumi di accesso ai dati su periodi estesi (trimestri) può evidenziare derive lente ma persistenti – il tipo di anomalia che le finestre di analisi brevi non catturano. Questo approccio è coerente con il framework di incident response del NIST SP 800-61r3 (aprile 2025), che integra le attività di detection all’interno delle funzioni CSF 2.0 e sottolinea la necessità di un monitoraggio continuo che alimenti la preparazione e il miglioramento iterativo della postura di sicurezza.

L’attribuzione si complica. Come documentato nell’analisi del caso GTG-5004, il codice generato dall’AI riflette pattern statistici del modello, non le idiosincrasie dell’attaccante. Ma quando l’attore è competente e integra l’output dell’AI nel proprio codice, il problema si inverte: il codice risultante è un ibrido umano-AI che non corrisponde a nessun profilo noto, rendendo la correlazione tra campagne più difficile. I team di threat intelligence devono integrare gli indicatori tradizionali di attribuzione (infrastruttura, timing operativo, targeting) con l’analisi dei pattern di utilizzo AI – il modo in cui l’output del modello viene integrato nel flusso operativo può diventare esso stesso un indicatore di attribuzione.

I controlli fondamentali restano la prima linea. L’operazione ha sfruttato vulnerabilità in WordPress, credenziali deboli, kernel non aggiornati. La sofisticazione dell’integrazione AI non cambia il fatto che la maggior parte delle intrusioni inizia con problemi risolvibili: patching, hardening, segmentazione di rete, autenticazione forte.

Come ha confermato CrowdStrike, l’81% delle intrusioni nel periodo luglio 2024-giugno 2025 è stato malware-free e basato su tecniche interattive – tecniche che i controlli di base possono mitigare, indipendentemente dal fatto che l’attaccante sia assistito dall’AI. La lezione operativa è duplice: i controlli fondamentali (MFA, patching, segmentazione, least privilege) riducono la superficie di attacco indipendentemente dalla sofisticazione dello strumento; le detection avanzate (NDR, XDR, correlazione multi-stadio, behavioral baselining) sono necessarie per intercettare ciò che i controlli di base non bloccano.

Lo scenario prossimo: dalla campagna singola all’operazione continua

La campagna vietnamita e la successiva GTG-1002 descrivono una traiettoria chiara. L’APT cinese AI non è un episodio isolato: è un modello operativo in fase di industrializzazione. La combinazione di competenze umane consolidate, AI come moltiplicatore sistematico e targeting allineato a interessi strategici nazionali produce un profilo di minaccia che i framework tradizionali – progettati per classificare attori con competenze statiche e tool riconoscibili – faticano a catturare.

Il Cybersecurity Forecast 2026 di Google prevede che l’uso di strumenti AI diventerà la normalità operativa sia per gli attaccanti sia per i difensori, con la prompt injection come uno dei vettori in più rapida crescita. Il framework di Recorded Future ha documentato come le operazioni di spionaggio cinese nel Sud-Est asiatico supportino sistematicamente gli obiettivi strategici di Pechino – dal Mar Cinese Meridionale alla Belt and Road Initiative – con un livello di coordinamento che l’AI è pronta ad amplificare.

Per i CISO e gli architetti della sicurezza, la lezione della campagna vietnamita è duplice. Sul piano tattico, la difesa deve essere distribuita su tutte le fasi del ciclo di attacco, con detection comportamentale che possa identificare l’accelerazione AI-driven – pattern di scansione a velocità non umana, enumerazione sistematica troppo rapida e troppo ampia per un singolo operatore. Sul piano strategico, il modello del moltiplicatore dimostra che l’AI non livella solo verso il basso (consentendo ai non esperti di attaccare), ma livella anche verso l’alto, amplificando le capacità degli operatori già sofisticati in modo che sfidano le risorse di interi team difensivi.

L’APT cinese AI che ha integrato Claude in 12 delle 14 tattiche MITRE ATT&CK è un case study che definisce il presente. La domanda per i difensori non è se i propri avversari stiano già utilizzando l’AI in questo modo – è se le proprie difese siano calibrate per un avversario che lo fa.

Questo è il quinto articolo della serie “AI offensiva nella cybersecurity”. Il primo articolo ha introdotto il quadro generale delle minacce AI-driven e il framework normativo. Il secondo articolo ha ricostruito l’operazione GTG-2002 e il paradigma del vibe hacking. Il terzo articolo ha analizzato il no-code malware e il caso GTG-5004. Il quarto articolo ha esaminato la frode occupazionale nordcoreana assistita dall’AI. Il prossimo articolo approfondirà le strategie di difesa AI-native contro le minacce AI-driven.

Fonti principali

Anthropic, Threat Intelligence Report: August 2025

Anthropic, Disrupting the first reported AI-orchestrated cyber espionage campaign, novembre 2025

Google Threat Intelligence Group (GTIG), AI Threat Tracker: Distillation, Experimentation, and Integration of AI for Adversarial Use, febbraio 2026

Google, Cybersecurity Forecast 2026

MITRE, ATT&CK Framework – v18.1, dicembre 2025

MITRE, ATLAS Framework – aggiornamento ottobre 2025

CrowdStrike, Global Threat Report 2025

The Diplomat, Southeast Asia: China’s Cyber Incubator and the Looming Day One Threat, ottobre 2025

Jackson School of International Studies, Cybersecurity Profile 2025: Vietnam

ORF, China’s cyber aggression and the South China Sea dispute, aprile 2025

CYFIRMA, The Changing Cyber Threat Landscape Southeast Asia

Recorded Future, Chinese State-Sponsored Cyber Espionage Activity Supports Expansion in Southeast Asia

ExtraHop, Anthropic AI Attack: How NDR Detects GTG-1002, novembre 2025

NIST, SP 800-61r3 – Incident Response Recommendations and Considerations for Cybersecurity Risk Management, aprile 2025

ASEC, Analysis of Gunra Ransomware Using Vulnerable Random Number Generation Function, dicembre 2025