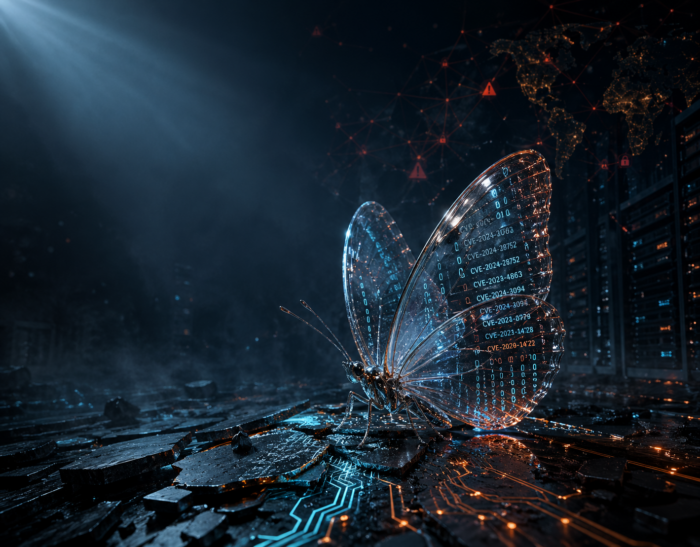

Caso Mythos: l’AI che trova zero-day in autonomia, il leak su Discord e la nuova economia delle vulnerabilità

Il 7 aprile 2026 Anthropic ha annunciato Claude Mythos Preview, un modello che individua in autonomia zero-day in ogni principale sistema operativo e browser. Due settimane dopo, Bloomberg ha rivelato che un gruppo Discord aveva avuto accesso al modello fin dal giorno del lancio. Tra hype, fact-checking indipendente e l’allarme di CERT-EU, il caso ridefinisce…