Whistleblower Tool europeo per l’AI Act: preparare l’azienda alla governance multilivello delle segnalazioni

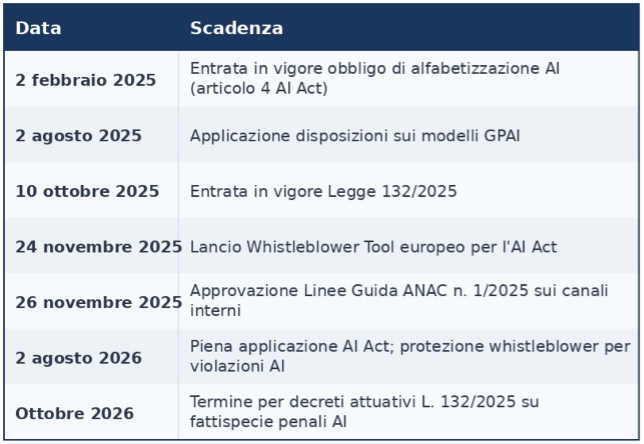

Il Whistleblower Tool europeo per l’AI Act rappresenta un punto di svolta nella strategia di enforcement del Regolamento UE 2024/1689. Lanciato il 24 novembre 2025 dall’European AI Office, questo strumento inaugura un canale di segnalazione diretto tra insider aziendali e autorità sovranazionale, bypassando di fatto le strutture nazionali tradizionali. Per le imprese italiane, già impegnate nell’implementazione della Legge 132/2025 e delle nuove Linee Guida ANAC n. 1/2025 sui canali interni di whistleblowing, si configura una sfida di integrazione sistemica senza precedenti. Questo articolo analizza le implicazioni operative della governance multilivello che ne deriva, proponendo una roadmap strategica per CISO, compliance officer e legal counsel.

Il contesto: perché il Whistleblower Tool europeo per l’AI Act cambia le regole del gioco

Il Whistleblower Tool europeo per l’AI Act non è semplicemente un nuovo canale di segnalazione. È l’espressione concreta di una filosofia regolatoria che intende trasformare ogni professionista con accesso ai sistemi di intelligenza artificiale in un potenziale controllore. La scelta della Commissione Europea di attivare lo strumento a novembre 2025, mesi prima dell’entrata in vigore della protezione legale completa prevista dalla Direttiva Whistleblowing 2019/1937 per le violazioni dell’AI Act (fissata al 2 agosto 2026), rivela un’urgenza strategica: anticipare l’enforcement attraverso il coinvolgimento diretto degli insider.

La piattaforma, operativa tramite IntegrityLine con crittografia certificata da ente indipendente, consente a chiunque abbia una relazione professionale con un fornitore di modelli AI di segnalare pratiche potenzialmente dannose. L’anonimato è garantito tecnicamente, ma la protezione giuridica contro le ritorsioni rimane, fino ad agosto 2026, subordinata alla riconducibilità della violazione segnalata a materie già coperte dalla Direttiva 2019/1937: sicurezza dei prodotti, protezione dei consumatori, privacy, sicurezza delle reti e dei sistemi informativi.

Questo gap temporale genera uno scenario di rischio asimmetrico. L’azienda può essere oggetto di segnalazioni verificate dall’AI Office fin da oggi; il segnalante, invece, gode di tutele piene solo se la violazione rientra nelle categorie preesistenti. Per un CISO o un DPO, la conseguenza operativa è immediata: occorre presumere che ogni criticità nei sistemi AI possa essere oggetto di segnalazione europea, anche in assenza di una violazione formale dell’AI Act.

La stratificazione normativa italiana: Legge 132/2025 e Linee Guida ANAC n. 1/2025

L’Italia ha disciplinato la materia con la Legge 23 settembre 2025, n. 132, pubblicata in Gazzetta Ufficiale n. 223 del 25 settembre 2025 ed entrata in vigore il 10 ottobre 2025. Si tratta del primo quadro normativo nazionale organico sull’intelligenza artificiale in Europa, un primato che tuttavia porta con sé il peso di un’implementazione accelerata. La legge attribuisce ad AgID funzioni di promozione e sviluppo, mentre l’Agenzia per la Cybersicurezza Nazionale (ACN) assume compiti di vigilanza, ispezione e sanzione. Mancano tuttavia i decreti attuativi previsti dall’articolo 24, che dovranno specificare le fattispecie di reato connesse all’uso illecito dei sistemi AI entro ottobre 2026.

In parallelo, il 26 novembre 2025 l’ANAC ha approvato le Linee Guida n. 1/2025 sui canali interni di whistleblowing con Delibera n. 478, completando il quadro regolatorio avviato con la Delibera 311/2023 sui canali esterni. Il messaggio è inequivocabile: il canale interno di segnalazione deve essere parte integrante del Modello 231, coordinato con la mappatura dei rischi, i flussi informativi verso l’Organismo di Vigilanza e il sistema disciplinare. Non è più accettabile un approccio “a silos” che isoli il whistleblowing dalle altre funzioni di controllo.

Le Linee Guida ANAC introducono inoltre una novità rilevante: la possibilità per il segnalante di rivolgersi direttamente al canale esterno ANAC qualora il canale interno sia assente o inadeguato. Questa apertura, combinata con l’esistenza del Whistleblower Tool europeo per l’AI Act, configura una triplice via di segnalazione che le aziende devono presidiare simultaneamente.

Anatomia del rischio: cosa può essere segnalato e da chi

Per comprendere la portata del nuovo scenario, è essenziale mappare con precisione perimetro soggettivo e oggettivo delle segnalazioni.

Soggetti legittimati a segnalare

Il Whistleblower Tool europeo per l’AI Act è accessibile a qualsiasi individuo “professionally connected” con un fornitore di modelli AI. La formula, volutamente ampia, include dipendenti, collaboratori, consulenti, fornitori, subappaltatori, e potenzialmente anche ex dipendenti o candidati a posizioni lavorative. La Direttiva 2019/1937 estende la protezione anche ai “facilitatori”, ossia coloro che assistono il segnalante nel processo di denuncia.

A livello nazionale, il D.Lgs. 24/2023 e le Linee Guida ANAC replicano sostanzialmente questa ampiezza soggettiva, con la differenza che il canale interno è rivolto primariamente ai soggetti con rapporto di lavoro subordinato o parasubordinato, mentre il canale esterno ANAC e quello europeo non presuppongono vincoli contrattuali specifici.

Oggetto delle segnalazioni

Il Whistleblower Tool europeo è destinato a ricevere segnalazioni relative a violazioni dell’AI Act concernenti modelli di AI general-purpose (GPAI) e determinati sistemi AI. Rientrano nel perimetro:

- mancata conformità ai requisiti di trasparenza per i modelli GPAI (articolo 53 AI Act)

- inadeguatezza delle misure di cybersecurity per modelli con rischio sistemico (articolo 55 AI Act)

- violazioni degli obblighi di documentazione tecnica e informativa ai deployer

- utilizzo di sistemi AI vietati dall’articolo 5 (manipolazione subliminale, sfruttamento di vulnerabilità, social scoring)

- non conformità dei sistemi AI ad alto rischio ai requisiti di robustezza, accuratezza e supervisione umana

A livello nazionale, la Legge 132/2025 aggiunge fattispecie specifiche: violazioni degli obblighi di trasparenza nell’uso dell’AI in ambito sanitario (articolo 7), lavoristico (articolo 11), giudiziario (articolo 15) e nella pubblica amministrazione (articolo 14). Le Linee Guida ANAC, infine, estendono l’oggetto delle segnalazioni a qualsiasi violazione del diritto dell’Unione o nazionale rilevante ai fini anticorruzione, antiriciclaggio, protezione dei dati, sicurezza dei prodotti e dei luoghi di lavoro.

La governance multilivello: architettura operativa per le aziende italiane

La coesistenza di tre canali di segnalazione (interno aziendale, esterno ANAC, europeo AI Office) impone un ripensamento dell’intera architettura di compliance. Non si tratta di duplicare presidi, ma di costruire un sistema integrato che garantisca:

- Priorità al canale interno: le Linee Guida ANAC e la stessa Direttiva Whistleblowing privilegiano la segnalazione interna come primo step. L’azienda deve rendere il canale interno effettivamente attrattivo, riducendo il rischio che il segnalante scelga direttamente la via esterna o europea.

- Tracciabilità delle segnalazioni: ogni segnalazione deve essere documentata, anche quando non porta all’accertamento di una violazione. Il Whistleblower Tool europeo per l’AI Act prevede comunicazioni bidirezionali cifrate: l’azienda non saprà che una segnalazione è stata inoltrata all’AI Office, ma potrebbe essere raggiunta da richieste di informazioni o ispezioni.

- Coordinamento tra funzioni: l’Organismo di Vigilanza 231 può essere designato gestore delle segnalazioni, ma deve operare con incarico separato dalla funzione di vigilanza sul Modello. Il DPO deve essere coinvolto per i profili privacy; il CISO per le implicazioni di sicurezza dei sistemi AI; il legal counsel per la valutazione delle esposizioni.

- Formazione mirata: l’articolo 4 dell’AI Act impone l’obbligo di alfabetizzazione AI per tutti i soggetti coinvolti, in vigore dal 2 febbraio 2025. Le Linee Guida ANAC richiedono formazione specifica sul whistleblowing. L’intersezione delle due prescrizioni genera un obbligo di formazione integrata che le aziende italiane devono implementare.

Implicazioni per la cybersecurity: il CISO come snodo critico

Il ruolo del Chief Information Security Officer nella governance del Whistleblower Tool europeo per l’AI Act merita un’analisi specifica. L’articolo 55 del Regolamento UE 2024/1689 impone ai fornitori di modelli GPAI con rischio sistemico di garantire “un livello adeguato di protezione della cibersicurezza”. Una segnalazione che evidenzi lacune in questo ambito può innescare procedimenti ispettivi dell’AI Office con conseguenze reputazionali e sanzionatorie.

Il CISO deve quindi presidiare:

- La sicurezza delle infrastrutture AI: i modelli addestrati internamente o acquisiti da terzi devono essere sottoposti a valutazione del rischio cyber, con particolare attenzione agli attacchi adversarial, al data poisoning e all’esfiltrazione di training data.

- La gestione degli accessi: l’accesso ai sistemi AI e ai relativi dati di addestramento deve seguire il principio del least privilege, con logging granulare delle operazioni.

- La protezione del canale di segnalazione interno: il sistema di whistleblowing aziendale deve garantire standard di crittografia e anonimizzazione almeno equivalenti a quelli del Whistleblower Tool europeo.

- La risposta agli incidenti: l’articolo 55 richiede la segnalazione di incidenti gravi all’AI Office. La procedura di incident response deve includere criteri di valutazione specifici per le violazioni dell’AI Act.

Tempistiche e scadenze: una roadmap per il 2026

Il calendario normativo impone un’accelerazione decisa.

Per le aziende italiane, il periodo febbraio-agosto 2026 rappresenta una finestra critica. L’assenza di protezione legale piena per i segnalanti di violazioni AI non impedisce la ricezione e valutazione delle segnalazioni da parte dell’AI Office; significa però che l’azienda potrebbe essere indagata sulla base di segnalazioni provenienti da soggetti non ancora formalmente tutelati, con rischi di contenziosi paralleli.

Raccomandazioni operative: un framework in cinque pilastri

Sulla base dell’analisi condotta, si propone un framework di adeguamento articolato in cinque pilastri.

Pilastro 1: Assessment del sistema di segnalazione esistente

Verificare se il canale interno di whistleblowing soddisfa i requisiti delle Linee Guida ANAC n. 1/2025: designazione formale del gestore, procedura documentata, garanzie di riservatezza, termini di riscontro al segnalante (7 giorni per la presa in carico, 3 mesi per l’esito). Identificare eventuali gap rispetto agli standard del Whistleblower Tool europeo per l’AI Act.

Pilastro 2: Integrazione nel Modello 231

Aggiornare il Modello di Organizzazione, Gestione e Controllo ex D.Lgs. 231/2001 inserendo esplicitamente i rischi connessi all’utilizzo di sistemi AI, le procedure di segnalazione interna ed esterna e i flussi informativi verso l’OdV. Le Linee Guida ANAC precisano che l’adozione del canale whistleblowing non può essere un adempimento autonomo, ma deve integrarsi con la mappatura complessiva dei rischi.

Pilastro 3: Due diligence sui fornitori AI

Implementare procedure strutturate di qualificazione dei provider di sistemi AI, con verifica documentale della conformità all’AI Act e alla L. 132/2025, analisi contrattuale delle clausole su responsabilità, accesso ai dati, audit rights. La Legge 132/2025 richiede la tracciabilità delle decisioni influenzate da AI: ogni output algoritmico deve essere associato alla documentazione del sistema che lo ha generato.

Pilastro 4: Formazione integrata AI-Whistleblowing

Progettare percorsi formativi che coprano simultaneamente l’alfabetizzazione AI ex articolo 4 del Regolamento e la consapevolezza sulle procedure di segnalazione. La formazione deve essere differenziata per ruolo: il personale tecnico necessita di approfondimenti sui rischi sistemici dei modelli GPAI; le funzioni HR e legal devono comprendere le tutele del segnalante; il management deve interiorizzare le responsabilità di governance.

Pilastro 5: Monitoraggio e revisione continua

Istituire un processo di revisione periodica che tenga conto dell’evoluzione normativa (decreti attuativi L. 132/2025, linee guida AgID, standard armonizzati europei) e dell’esperienza operativa maturata. Il Whistleblower Tool europeo per l’AI Act genererà inevitabilmente casistica che orienterà l’interpretazione delle norme: monitorare le decisioni dell’AI Office diventa essenziale per l’aggiornamento delle policy interne.

Prospettive: verso un ecosistema di segnalazione integrato

Il lancio del Whistleblower Tool europeo per l’AI Act segna l’ingresso dell’intelligenza artificiale nel perimetro consolidato della compliance di derivazione europea. Per le aziende italiane, già impegnate su fronti multipli (NIS2, DORA, GDPR, D.Lgs. 231/2001), si aggiunge un ulteriore livello di complessità che richiede visione sistemica e capacità di coordinamento interfunzionale.

La tentazione di affrontare ciascun obbligo in modo isolato è comprensibile ma controproducente. L’approccio vincente consiste nel costruire una governance integrata che tratti la sicurezza informatica, la protezione dei dati, la prevenzione della corruzione e la conformità AI come facce di un unico prisma regolamentare. In questa prospettiva, il canale di segnalazione interno diventa il primo sensore di un sistema di early warning che intercetta le criticità prima che raggiungano le autorità esterne.

Il Whistleblower Tool europeo per l’AI Act non è una minaccia, ma un’opportunità: quella di dimostrare maturità organizzativa, trasparenza nei confronti degli stakeholder, capacità di gestire proattivamente i rischi emergenti dell’intelligenza artificiale. Le aziende che sapranno cogliere questa opportunità costruiranno un vantaggio competitivo destinato a consolidarsi negli anni a venire.