Cybersecurity 2026: dalla difesa del perimetro alla resilienza come disciplina

La cybersecurity nel 2026 non è più quella di tre anni fa. Non perché siano arrivate minacce nuove – le minacce evolvono continuamente – ma perché è cambiato il modo in cui le organizzazioni concepiscono, strutturano e praticano la difesa. Il perimetro da proteggere non esiste più. La prevenzione assoluta non è più l’obiettivo. Il CISO non è più un responsabile tecnico. Il SOC non è più una sala di monitoraggio reattivo.

Questi non sono cambiamenti cosmetici. Sono rotture di paradigma che ridefiniscono la professione, le architetture, i processi e le responsabilità. Le organizzazioni più mature stanno spostando il focus dalla reazione all’anticipazione, integrando sicurezza, governance e scelte infrastrutturali in un unico disegno. La cybersicurezza nel 2026 è sempre più una disciplina di resilienza, non una somma di strumenti.

Questo articolo analizza i cambiamenti strutturali che definiscono la cybersecurity 2026 dal punto di vista di chi la pratica: come sono cambiate le architetture, come si è trasformato il SOC, come è evoluto il ruolo del CISO, cosa ha prodotto la normativa, e dove si sta andando.

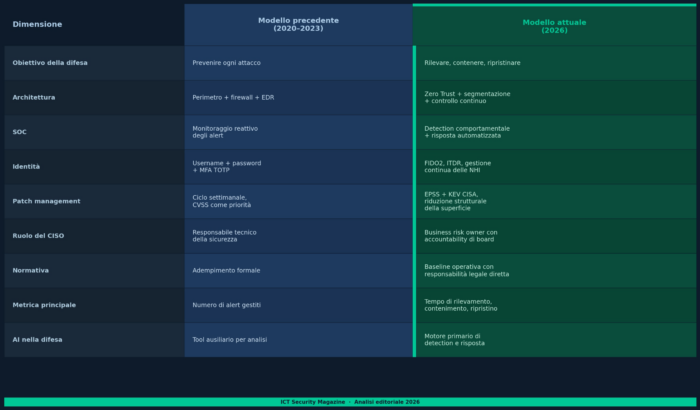

Il quadro: cosa è cambiato davvero nel 2026

Prima di entrare nel dettaglio, è utile fissare il perimetro del cambiamento. Non si tratta di singole tecnologie adottate o abbandonate: si tratta di trasformazioni nella filosofia difensiva.

Ogni riga di questa tabella racconta un cambiamento reale, con cause documentabili e conseguenze operative misurabili.

La fine del perimetro e la nascita dell’architettura Zero Trust operativa

Il modello perimetrale – un confine netto tra «dentro» e «fuori» l’organizzazione, con un firewall a sorvegliarlo – è stato dichiarato obsoleto da anni. Nel 2026 è finalmente morto nella pratica, non solo nella teoria.

La causa non è stata una scelta strategica, ma l’accumulo di fatti impossibili da ignorare: il lavoro ibrido ha dissolto il confine fisico della rete aziendale, il cloud ha spostato le risorse fuori dal perimetro controllabile, e gli attaccanti hanno imparato da tempo a entrare con credenziali legittime anziché forzare il perimetro.

Secondo il Microsoft Digital Defense Report 2025, Microsoft registra oltre 600 milioni di attacchi alle identità al giorno, e le tecniche di bypass della MFA tradizionale – in particolare gli attacchi Adversary-in-the-Middle (AiTM) – sono in rapida crescita: il proxy si interpone tra utente e servizio, intercetta il codice TOTP in tempo reale e lo ritrasmette prima che scada. Il confine non ferma chi ha le chiavi – o chi riesce a rubarne una copia al volo.

La difesa informatica nel 2026 non è più un perimetro da proteggere, ma un ecosistema dinamico da presidiare costantemente. Il modello Zero Trust – codificato nel NIST SP 800-207 e basato sul principio «non fidarsi mai, verificare sempre» – è diventato lo standard di riferimento per le architetture di sicurezza.

Il Zero Trust nel 2026 non è più un concetto: è un’architettura operativa con componenti specifici. La micro-segmentazione divide la rete in zone indipendenti, limitando il lateral movement anche quando un attaccante ottiene accesso a un segmento. L’autenticazione continua verifica ogni richiesta di accesso in funzione del contesto – chi è l’utente, da quale dispositivo, da quale posizione, a quale ora, con quale comportamento precedente – e non solo all’ingresso. Le policy di accesso dinamiche si adattano in tempo reale al livello di rischio della sessione. Il principio del minimo privilegio viene applicato non solo agli utenti umani, ma a ogni servizio, agente e processo automatico.

La trasformazione del SOC in un sistema nervoso capace di correlare segnali provenienti da domini diversi – rete, cloud, endpoint, ma anche accessi fisici e OT – è la direzione verso cui le organizzazioni più mature si stanno muovendo. È in quelle correlazioni «deboli» che l’AI di difesa trova i pattern utili a fermare l’attacco prima che diventi incidente.

Il SOC si trasforma: dal monitoraggio degli alert alla detection comportamentale

Il problema strutturale che ha accelerato la trasformazione

Il SOC tradizionale è stato progettato per gestire alert. Nel 2026, il volume di alert ha superato di gran lunga la capacità operativa di qualsiasi team umano: solo nella settimana dell’11-17 febbraio 2026, un SOC medio si è trovato a gestire simultaneamente patch critiche su Ivanti, BeyondTrust, Microsoft (59 CVE), Apple, audit di estensioni browser, monitoring della supply chain npm e PyPI, e la botnet SSHStalker. Non è un problema di efficienza – è un guasto architetturale del modello reattivo.

Emerge con forza il paradigma del Risk Operations Center, analizzato nel Qualys TruRisk Research Report: le operazioni si basano sulla priorità del rischio e su un triage intelligente che elimina il superfluo, permette di risparmiare risorse e consente ai team di concentrarsi su ciò che realmente conta nel momento in cui conta.

Il Risk Operations Center non è solo un rebranding del SOC. È un cambio di logica operativa: il centro non gestisce più alert come unità di lavoro elementare, ma gestisce il rischio come metrica aggregata. La prioritizzazione non si basa sul CVSS – che misura la gravità teorica di una vulnerabilità – ma su EPSS (Exploit Prediction Scoring System, che misura la probabilità di exploitation nei successivi 30 giorni) e sul catalogo KEV di CISA (che documenta le vulnerabilità attivamente sfruttate in the wild). La differenza pratica è enorme: una CVE con CVSS 9.8 non ancora sfruttata può aspettare; una CVE con CVSS 6.5 presente nel KEV richiede azione immediata.

L’AI come motore della detection, non come strumento ausiliario

Nel 2026, l’AI non è più un componente opzionale della difesa: è il motore primario della detection comportamentale. I backup e la protezione degli endpoint continuano a essere fondamentali, ma i veri fattori di differenziazione diventano il rilevamento delle anomalie comportamentali, la rapidità e l’automazione del contenimento, e le architetture Zero Trust.

Il cambiamento operativo concreto è nel tipo di segnale che i sistemi difensivi cercano. I sistemi EDR tradizionali cercavano indicatori di compromissione (IOC): hash di file malevoli noti, indirizzi IP di C2 documentati, signature di malware catalogati. Un attaccante che usa strumenti legittimi – come fa il BYOVD (Bring Your Own Vulnerable Driver) con driver firmati Windows – non genera IOC rilevabili. Secondo il Picus Red Report 2026, il 93% dei malware analizzati utilizza tecniche incluse nel framework MITRE ATT&CK che sfruttano strumenti legittimi del sistema operativo (LOLBAS – Living Off the Land Binaries and Scripts), rendendo il rilevamento basato su signature strutturalmente insufficiente.

I sistemi basati su AI cercano invece indicatori di comportamento anomalo (IOB): un processo che termina 59 altri processi in sequenza con intervallo di un secondo è anomalo anche se il processo è firmato da un vendor legittimo; un account che scarica 50 GB di dati alle 3 di notte è anomalo anche se ha superato l’autenticazione. Questa è la differenza tra detection basata su signature e detection comportamentale – e nel 2026 la seconda è diventata il requisito minimo.

Sul fronte delle identità, si afferma il paradigma Identity Threat Detection and Response (ITDR): non è più sufficiente presidiare chi accede a cosa; diventa indispensabile rilevare comportamenti anomali, movimenti laterali e tentativi di abuso in tempo quasi reale, tanto per gli account utente quanto per le identità macchina e agentiche.

L’identità come superficie primaria: ITDR, NHI e la crisi della MFA tradizionale

Identity Threat Detection and Response: la nuova disciplina

La cybersecurity nel 2026 ha identificato nell’identità la superficie d’attacco più critica – e ha risposto con una disciplina specifica: ITDR, Identity Threat Detection and Response. Non è un prodotto: è un approccio che integra il monitoraggio continuo del comportamento delle identità, il rilevamento delle anomalie, e la risposta automatizzata agli abusi di credenziali.

L’ITDR nasce dalla constatazione che i sistemi IAM tradizionali sono stati costruiti per gestire l’accesso – chi può fare cosa. Non sono stati costruiti per rilevare quando un accesso legittimo viene usato in modo anomalo. Un token OAuth valido usato per scaricare l’intera knowledge base aziendale è formalmente autorizzato; operativamente è un furto di dati. Solo un sistema che monitora il comportamento delle identità nel tempo – e non solo i singoli accessi – può distinguere i due casi.

La disciplina si sta evolvendo verso l’Identity Security Posture Management: soluzioni che combinano valutazione continua del rischio, policy dinamiche e automazione delle risposte, con l’obiettivo di ridurre l’esposizione complessiva e interrompere il ciclo di fallimenti legati alle identità prima che si trasformino in incidenti su larga scala.

Il problema delle identità macchina: 82:1 e nessuno le governa

La disciplina ITDR nel 2026 deve affrontare una realtà che i sistemi IAM tradizionali non erano stati progettati per gestire. Secondo il CyberArk Identity Security Threat Landscape Report 2025, le identità non umane superano quelle umane in rapporto 82:1, crescono al 44% annuo, e il 97% dispone di privilegi eccessivi rispetto alle effettive esigenze operative.

Il problema non è tecnico – è di governance. Le identità macchina (API key, service account, token OAuth, certificati TLS) vengono create per ogni progetto, PoC e integrazione; raramente vengono rimosse quando il progetto finisce; quasi mai vengono sottoposte a review dei privilegi. Il risultato è un ecosistema di «fantasmi permanenti» nell’infrastruttura – credenziali attive, privilegiate, non monitorate, che rappresentano finestre di vulnerabilità aperte per anni.

Le conseguenze sono documentate da casi concreti. Nel breach Okta dell’ottobre 2023, il vettore iniziale fu un service account con accesso al sistema di gestione dei ticket di supporto: le credenziali dell’account erano state sincronizzate – senza che nessuno lo sapesse – nel profilo Google personale di un dipendente. Il service account non aveva MFA, aveva privilegi ampi, e non veniva monitorato comportamentalmente. Risultato: 134 clienti Okta esposti, inclusi BeyondTrust, 1Password e Cloudflare. Nella campagna Snowflake del 2024, credenziali di account di integrazione – prive di MFA e non sottoposte a rotation – hanno permesso agli attaccanti di esfiltrare dati da decine di organizzazioni clienti, tra cui Ticketmaster e Santander.

La risposta della cybersecurity 2026 è costruire programmi di NHI management (Non-Human Identity) con le stesse caratteristiche di rigore che da decenni si applicano alle identità umane: inventario sistematico, principio del minimo privilegio applicato rigorosamente, revoca automatica delle credenziali inattive, e monitoraggio comportamentale dedicato. Non è ancora prassi comune – ma chi ha subito breach attraverso questo vettore lo sta implementando con urgenza.

Verso FIDO2: la fine della MFA tradizionale

La crescente efficacia degli attacchi AiTM nel bypassare la MFA TOTP ha accelerato la migrazione verso FIDO2/WebAuthn come standard di autenticazione forte. La differenza fondamentale è architetturale: nei sistemi TOTP, il codice a sei cifre può essere intercettato in tempo reale da un proxy AiTM e ritrasmesso prima che scada. In FIDO2, la chiave privata non lascia mai il dispositivo fisico e il protocollo verifica crittograficamente il dominio del sito, rendendo impossibile il relay: anche se l’attaccante intercettasse la comunicazione, non potrebbe usarla su un dominio diverso.

La migrazione non è immediata: richiede hardware dedicato (security key) o dispositivi compatibili, un processo di enrollment che tocca ogni utente, e la gestione delle eccezioni per i casi d’uso legacy. Ma nel 2026, le organizzazioni che operano in settori ad alto rischio – finanza, infrastrutture critiche, healthcare – l’hanno già completata o la stanno eseguendo come priorità di primo livello. Anche i principali provider di identità cloud (Microsoft, Google, Okta) raccomandano ora FIDO2 come standard minimo per gli amministratori di sistema.

Il ruolo del CISO: da responsabile tecnico a business risk owner

La trasformazione del profilo professionale

Il CISO del 2026 non è lo stesso del 2020. Non perché siano cambiate le competenze tecniche richieste – quelle servono ancora – ma perché è radicalmente cambiato il contesto in cui opera e la tipologia di interlocutori con cui deve lavorare.

Il compito del CISO moderno è mappare iniziative, asset, modelli e valore a rischio, dimostrare quale impatto reale stiano producendo gli investimenti, valutare il rischio residuo e capire cosa serve per riportarlo entro la tolleranza aziendale. In un contesto in cui il capitale si sposta verso tutto ciò che è AI, questa capacità di misurare e mostrare valore diventa decisiva.

Tre cambiamenti strutturali definiscono il profilo del CISO nel 2026.

Il primo è la responsabilità legale diretta. NIS2 e DORA hanno trasformato la sicurezza informatica da funzione tecnica a obbligo normativo con responsabilità personale per gli organi di amministrazione e direzione. Il CISO non risponde più solo al CEO – risponde anche al regolatore, con sanzioni che possono essere personali e dirette.

Il secondo è il dialogo con il board. Il board chiede metriche di rischio aziendale, non conteggi di alert gestiti. Il CISO del 2026 deve tradurre il rischio tecnico in impatto economico, esprimere la postura difensiva in termini comprensibili a chi ha responsabilità fiduciarie sull’organizzazione, e giustificare gli investimenti in sicurezza con la stessa logica con cui si giustifica qualsiasi altra allocazione di capitale.

Il terzo è la gestione della cyber insurance. Chi ha una postura di sicurezza solida e misurabile può ottenere coperture migliori a costi contenuti; chi investe presto in visibilità avrà margine di trattativa quando il mercato diventerà più rigido. La cyber insurance nel 2026 è diventata uno strumento di risk financing che il CISO gestisce insieme al CFO e al risk manager – non un prodotto assicurativo che l’IT acquista per mandato del management.

Il problema della trasparenza radicale

La mossa più audace – e ancora rara – che le organizzazioni più mature stanno compiendo è adottare una trasparenza radicale nella gestione degli incidenti: capovolgere il paradigma della violazione come crisi PR significa informare subito clienti e stakeholder quando emerge un’attività anomala, anche prima di comprendere tutta la portata dell’evento.

Questo cambiamento culturale – notificare proattivamente prima che sia obbligatorio farlo per legge – è uno degli indicatori di maturità più significativi della cybersecurity 2026. Le organizzazioni che lo hanno adottato riportano benefici concreti: maggiore fiducia degli stakeholder, migliori rapporti con i regolatori, e una cultura interna dove il reporting degli incidenti non è percepito come ammissione di colpa ma come strumento operativo.

La normativa come cambio strutturale: NIS2, DORA, D.Lgs. 138/2024, L. 132/2025 e CRA

Da adempimento formale a baseline operativa

Nel 2026 la NIS2 non è più percepita come una novità normativa, ma come una baseline operativa. Gestione del rischio, risposta agli incidenti, sicurezza della supply chain e accountability sono diventate aspettative consolidate.

Questo cambio di percezione ha conseguenze concrete. NIS2 – recepita in Italia con il D.Lgs. 138/2024 – impone obblighi che ridisegnano i processi operativi: notifica degli incidenti entro 24 ore per l’early warning e 72 ore per la notifica completa; misure di sicurezza della supply chain che estendono il perimetro di controllo ai fornitori critici; e accountability degli organi di amministrazione con possibilità di sanzioni personali. Obbliga inoltre le organizzazioni a partecipare ai meccanismi di condivisione delle informazioni sulle minacce – attraverso i CSIRT nazionali e le piattaforme ENISA – trasformando la threat intelligence da attività facoltativa a componente strutturale della gestione del rischio.

DORA (Reg. UE 2022/2554, applicabile dal gennaio 2025) ha introdotto per le entità finanziarie europee i Threat-Led Penetration Testing (TLPT) obbligatori secondo il framework TIBER-EU. Questi test non sono vulnerability assessment tradizionali: sono simulazioni di attacco reale condotte da red team certificati, progettate per testare la capacità dell’organizzazione di rilevare e contenere un attaccante avanzato in condizioni operative reali. Il requisito ha spinto molte organizzazioni finanziarie a formulare – per la prima volta – la domanda più importante: «Cosa succede concretamente quando il nostro EDR viene spento o aggirato?».

La Legge 23 settembre 2025, n. 132 – prima normativa organica italiana sull’intelligenza artificiale, in vigore dal 10 ottobre 2025 – non è un provvedimento di cybersecurity in senso stretto, ma ha implicazioni dirette e rilevanti per chi opera nel settore.

La legge ha designato ACN e AgID come autorità nazionali competenti in materia di AI: l’ACN assume la vigilanza tecnica sui sistemi AI con poteri ispettivi e sanzionatori, mentre AgID coordina la promozione e il regime di notifica. Per le organizzazioni che integrano AI nei processi di security – dagli strumenti di detection alle piattaforme SOAR – la compliance alla L. 132/2025 diventa parte integrante dell’AI governance, con obblighi di trasparenza, sorveglianza umana e tracciabilità che si sovrappongono ai requisiti tecnici di sicurezza.

Il Cyber Resilience Act (CRA, Reg. UE 2024/2847), in vigore progressiva fino al 2027, introduce obblighi di sicurezza by design su tutti i prodotti digitali venduti nel mercato UE. L’obbligo di produrre e mantenere un Software Bill of Materials (SBOM) – l’inventario completo dei componenti software con le relative versioni – non è più limitato ai produttori di software: riguarda chiunque sviluppi o distribuisca prodotti con elementi digitali. Per i team di sicurezza, questo significa che la gestione della supply chain software diventa un processo formale e documentato, non più una responsabilità implicita.

Le architetture cambiano: AI governance, post-quantum e confidential computing

AI governance: il nuovo imperativo architetturale

Il focus della cybersecurity 2026 si sposta dalla sola protezione delle infrastrutture alla protezione runtime di modelli, dati e identità lungo l’intero ciclo operativo. Nel mondo dell’AI, questo significa monitorare costantemente input, output e comportamenti dei modelli per intercettare prompt injection, data poisoning e tentativi di esfiltrazione.

L’AI governance è diventata nel 2026 una dimensione indispensabile dell’architettura di sicurezza. Non è solo una questione di compliance con l’EU AI Act e con la L. 132/2025: è una necessità operativa. Gli agenti AI con accesso a sistemi critici e privilegi eccessivi sono superfici d’attacco reali – e gli attaccanti lo sanno. I controlli che le organizzazioni mature stanno implementando includono:

- Kill switch operativi per interrompere agenti compromessi senza propagazione

- Blast radius limits che limitano l’accesso di ogni agente al minimo indispensabile per il task specifico

- Trust boundaries esplicite tra agenti diversi, con autenticazione delle comunicazioni inter-agente

- Behavioral drift monitoring che rileva quando un agente inizia a comportarsi in modo anomalo rispetto alla baseline storica

Il rischio non deriva solo da un’AI intenzionalmente malevola, ma anche da sistemi legittimi che operano in autonomia, dove un’«allucinazione» o una configurazione errata può tradursi in un evento operativo reale con impatti misurabili su sistemi di produzione.

Post-quantum: dalla consapevolezza alla pianificazione operativa

Con la pubblicazione degli standard definitivi e una roadmap sempre più concreta, il 2026 è l’anno in cui molte organizzazioni stanno passando dalla consapevolezza alla pianificazione operativa, avviando la mappatura sistematica della crittografia in uso e le prime transizioni verso algoritmi resistenti al calcolo quantistico.

Il NIST ha standardizzato nell’agosto 2024 i primi algoritmi post-quantum:

- ML-KEM (FIPS 203, derivato da CRYSTALS-Kyber) per la crittografia a chiave pubblica e lo scambio di chiavi – è oggi il sostituto raccomandato per RSA e ECDH nei protocolli TLS, VPN e PKI

- ML-DSA (FIPS 204, derivato da CRYSTALS-Dilithium) per le firme digitali – sostituisce RSA e ECDSA nella firma di certificati, codice e documenti

- SLH-DSA (FIPS 205, derivato da SPHINCS+) come alternativa stateless basata su hash per le firme digitali

A marzo 2025, il NIST ha inoltre selezionato HQC (Hamming Quasi-Cyclic) come algoritmo di backup per ML-KEM: basato su matematica diversa (code-based anziché lattice-based), serve a proteggere il sistema globale nel caso venissero scoperte vulnerabilità strutturali negli schemi lattice-based. È una decisione di diversificazione del rischio crittografico, analoga alla scelta di avere più algoritmi di firma per scopi diversi.

Il problema operativo non è tecnico – gli algoritmi esistono e sono pronti – ma logistico: mappare tutti i sistemi che usano crittografia asimmetrica (PKI, TLS, firma digitale, VPN, protocolli di autenticazione), e pianificare la migrazione con sufficiente anticipo per non trovarsi a farlo in emergenza. La minaccia «harvest now, decrypt later» – attori che oggi esfiltrано dati cifrati sapendo di poterli decifrare quando avranno accesso a capacità quantum – rende urgente la pianificazione per qualsiasi dato che debba rimanere riservato per più di cinque anni: dati sanitari, segreti industriali, archivi legali, comunicazioni diplomatiche.

Confidential computing: protezione dei dati in uso

Prende slancio il paradigma del confidential computing, che supera la tradizionale distinzione tra dati a riposo e in transito per estendere la protezione alla fase di elaborazione.

La crittografia tradizionale protegge i dati quando sono «fermi» (at rest) o «in movimento» (in transit). Il confidential computing protegge i dati anche quando sono «in uso» – durante l’elaborazione. Questo è rilevante in particolare per gli ambienti cloud, dove i dati vengono elaborati su hardware non sotto il controllo diretto dell’organizzazione. Le tecnologie TEE (Trusted Execution Environment) – Intel SGX, AMD SEV, ARM TrustZone – creano enclave hardware isolate in cui i dati vengono elaborati in modo che nemmeno il provider cloud possa accedervi in chiaro. L’adozione è ancora in fase di avanzamento, ma nei settori con requisiti di sovranità del dato più stringenti – sanità, difesa, servizi finanziari – il confidential computing sta diventando un requisito architetturale, non un’opzione.

La sovranità del dato e il cloud consapevole

La sovranità del dato si consolida come criterio chiave nelle scelte di architettura e di fornitore: governi e autorità regolatorie spingono per mantenere informazioni critiche all’interno di confini nazionali o regionali, con impatti rilevanti sulla progettazione di servizi cloud e AI distribuiti.

Nel 2026, la scelta del cloud provider non è più solo una questione di costo e performance: è una scelta con implicazioni di compliance, sovranità e rischio geopolitico. GDPR, D.Lgs. 138/2024, la Strategia Nazionale per la Cybersicurezza 2022-2026 e le direttive europee sul cloud critico definiscono perimetri sempre più precisi su dove possono risiedere determinati tipi di dati e chi può accedervi. La classificazione dei dati non è più un esercizio burocratico: è il prerequisito per qualsiasi scelta infrastrutturale consapevole.

Non si tratta di opporre cloud e on-premises, ma di costruire architetture ibride consapevoli, basate sulla classificazione dei dati, sul livello di criticità dei processi e sui requisiti di controllo richiesti dal business e dalla normativa. I dati più sensibili in ambienti con data residency garantita o on-premises; i workload meno critici su cloud pubblico con i controlli standard. La complessità architetturale aumenta, ma aumenta in funzione del rischio effettivo – non dell’inerzia organizzativa.

Il fattore umano: la competenza come variabile critica

Nessuna architettura, nessuno strumento, nessun framework normativo funziona senza le persone che li operano. Nel 2026 il gap di competenze nella cybersecurity non si è chiuso – si è ampliato, perché la velocità di evoluzione delle minacce e delle tecnologie supera sistematicamente la velocità di formazione dei professionisti.

Secondo il Semperis Ransomware Defense Report, il 78% dei SOC riduce il personale di oltre il 50% durante i fine settimana e i giorni festivi, mentre il 6% non ha alcuna copertura SOC in quei periodi. È una lacuna strutturale nella copertura che gli attaccanti sfruttano sistematicamente – la maggior parte degli attacchi ransomware viene attivata nelle ore notturne o durante i giorni festivi, proprio quando la capacità di risposta è ridotta.

La risposta non è solo assumere più persone – il mercato non ne ha abbastanza. È una combinazione di tre leve. La prima è l’automazione intelligente che riduce il carico operativo sui tier più bassi del SOC, gestendo automaticamente i casi a bassa complessità e liberando gli analisti per quelli ad alto rischio. La seconda è la formazione continua focalizzata sulle competenze effettivamente richieste dall’ambiente attuale, non quelle dei certificati di cinque anni fa: threat hunting, detection engineering, risposta agli incidenti su architetture cloud-native. La terza è il ricorso a MSSP (Managed Security Service Provider) per le funzioni standardizzabili, liberando i team interni per le attività che richiedono contesto aziendale specifico.

La simulazione come strumento formativo ha fatto un salto qualitativo nel 2026. Il modeling dei percorsi di attacco, fino a ieri confinato a grafi statici, evolve in digital cyber range dinamici, capaci di alimentare simulazioni continue, red teaming avanzato e scenari «what-if» in tempo reale. I team che si esercitano regolarmente su scenari realistici – incluso lo scenario «cosa facciamo se l’EDR viene spento o aggirato?» – rispondono in modo significativamente più efficace agli incidenti reali rispetto a quelli che si preparano solo su tabletop exercise teoriche.

Conclusione: la sicurezza come fattore abilitante, non come vincolo

Il cambiamento più profondo che la cybersecurity nel 2026 ha prodotto non è tecnico: è culturale e organizzativo. La sicurezza ha smesso di essere percepita – nelle organizzazioni più mature – come un freno all’innovazione o un costo da minimizzare. È diventata un fattore abilitante: la condizione che permette di adottare AI, cloud, agenti autonomi e tecnologie emergenti con sufficiente fiducia per trarne valore economico.

Questo cambio di prospettiva ha conseguenze pratiche e stringenti. Un’organizzazione che non governa le identità macchina non può adottare agenti AI a scala. Una che non ha implementato Zero Trust non può espandere il cloud in sicurezza. Una che non ha costruito capacità strutturata di risposta agli incidenti non può permettersi la trasparenza radicale che la normativa e il mercato iniziano a richiedere.

La cybersecurity 2026 non chiede di essere perfetti – nessuna architettura lo è, e nessun ambiente è imperforabile. Chiede qualcosa di più difficile: essere resilienti. Cioè capaci di assorbire l’inevitabile, rilevarlo prima che diventi catastrofico, contenerlo prima che si propaghi, e ripristinare le operazioni prima che il danno diventi irreversibile.

La resilienza non è uno stato che si raggiunge: è una disciplina che si pratica. Ed è questa la vera trasformazione che definisce la cybersecurity 2026.